스탠포드 대학 논문중에

https://cs.stanford.edu/~rcwang/projects/lego_manual/

https://github.com/Relento/lego_release

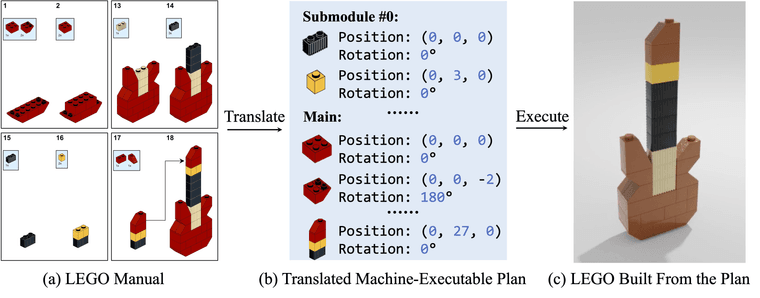

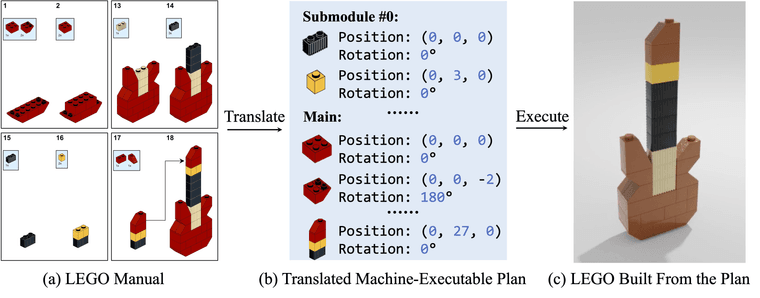

레고메뉴얼을 보고 그대로 만드는 프로그램 코드가 있습니다.

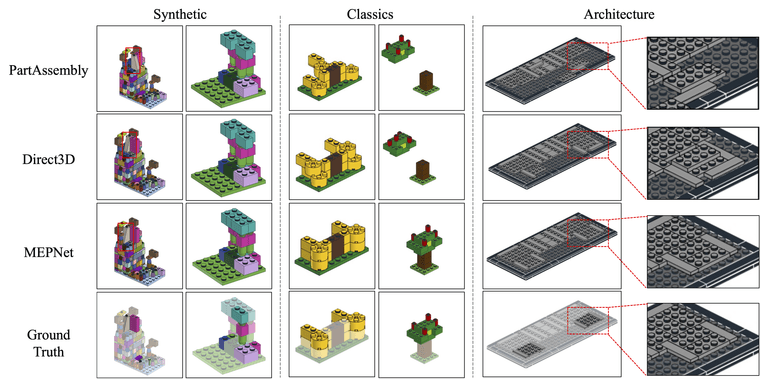

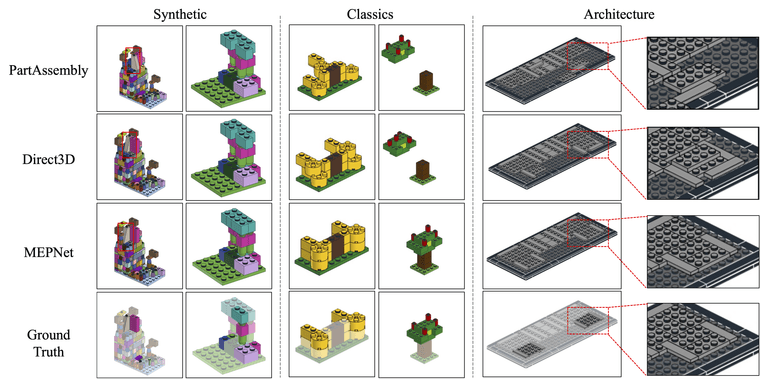

본 연구에서는 인간 설계자가 제작한 이미지 기반의 단계별 조립 설명서를 기계가 해석할 수 있는 지침으로 변환하는 문제를 다룹니다. 이 문제는 순차적 예측 작업으로 정식화됩니다. 각 단계에서 우리 모델은 설명서를 읽고 현재 형상에 추가될 구성 요소를 찾아 3D 자세를 추론합니다. 이 작업은 설명서 이미지와 실제 3D 객체 간의 2D-3D 대응 관계를 설정하는 것과, 새로운 구성 요소가 이전 단계에서 만들어진 객체일 수 있기 때문에 이전에 보지 못한 3D 객체에 대한 3D 자세 추정이라는 두 가지 과제를 안고 있습니다. 이러한 두 가지 과제를 해결하기 위해, 우리는 일련의 설명서 이미지로부터 조립 단계를 재구성하는 새로운 학습 기반 프레임워크인 MEPNet(Manual-to-Executable-Plan Network)을 제안합니다. 핵심 아이디어는 신경망 기반의 2D 키포인트 검출 모듈과 2D-3D 투영 알고리즘을 통합하여 높은 정확도의 예측과 이전에 보지 못한 구성 요소에 대한 강력한 일반화 성능을 구현하는 것입니다. MEPNet은 새로 수집된 세 가지 LEGO 설명서 데이터셋과 Minecraft 주택 데이터셋에서 기존 방법보다 우수한 성능을 보였습니다.

요즘이라면 사진이나 낙서를 3D모델로 바꿔볼만 할거 같다는 생각이 드네요

레고시리어스플레이 AI 버전이 가능할거 같은 희망이 ^^